L’azienda fondata dai fratelli Amodei sta crescendo in silenzio grazie a una visione pragmatica, focalizzata sui bisogni reali di chi lavora, ma le ombre non mancano…

📌 TAKE AWAYS

Anthropic sta conquistando il mercato aziendale grazie a un approccio più prudente e affidabile rispetto a OpenAI.

Claude offre prestazioni solide, soprattutto nel coding e nei contesti professionali, ma non mancano criticità legate alla sicurezza e alle pressioni politiche.

La competizione tra i due colossi rivela un cambiamento profondo nel modo in cui le imprese valutano e adottano l’intelligenza artificiale.

Apri gli occhi, prendi il primo caffè e la notifica è già lì: un nuovo aggiornamento, un nuovo modello più potente del precedente, un’altra “rivoluzione” che rende obsoleto quello che hai imparato ieri sera.

È la nuova normalità di chi fa impresa oggi.

Hai appena finito di adattare la tua strategia all’ultimo algoritmo ed ecco che le carte in tavola cambiano di nuovo. È un’escalation continua, brutale e senza sosta.

La sensazione è che in Silicon Valley viga ormai una sola legge marziale: uscire per primi.

Non importa se il prodotto è perfetto, testato o sicuro al 100%.

L’importante è battere il competitor sul tempo, occupare lo spazio, lanciare versioni ancora acerbe pur di non restare indietro.

Il risultato? Ci ritroviamo sommersi da strumenti potentissimi ma spesso instabili, incompleti, pieni di promesse e di difetti.

Eppure, in questa corsa forsennata dove vince chi urla più forte, esiste un’eccezione.

C’è un’azienda che ha scelto di non sacrificare l’affidabilità sull’altare della velocità.

Un player che, mentre tutti corrono a rilasciare prodotti “basta che funzionino”, si prende il tempo di costruire qualcosa che le aziende possano usare davvero senza rischi (o quasi…).

Sto parlando di Anthropic. Probabilmente ne senti parlare meno rispetto al clamore mediatico di OpenAI, ma è proprio qui il punto.

Mentre tutti guardano i fuochi d’artificio, due fratelli italo-americani cresciuti a San Francisco, Dario e Daniela Amodei, stanno costruendo uno degli imperi più solidi e razionali dell’intera Silicon Valley.

Seguimi, perché questa storia riguarda il tuo fatturato molto più di quanto immagini.

Le radici italiane e il rifiuto del “circo mediatico”

Immagina due ragazzi cresciuti respirando l’aria della baia di San Francisco e i racconti di una famiglia italiana tosta, di quelle che non le mandano a dire.

Dario e Daniela Amodei non sono i classici startupper della generazione TikTok.

Il padre, Riccardo, era un artigiano specializzato nella lavorazione della pelle, emigrato dalla Toscana negli anni Settanta; uno che sapeva che la qualità richiede tempo e che un prodotto deve durare, non solo luccicare per cinque minuti.

C’è un aneddoto che Daniela ama raccontare e che spiega tutto della loro filosofia aziendale.

La loro nonna materna, negli anni Trenta, si incatenò ai cancelli del consolato italiano a Chicago.

Il motivo? Protestava contro l’invasione dell’Etiopia. Questo senso di responsabilità etica, di fare la cosa giusta anche quando è scomoda, è il DNA di Anthropic (almeno in teoria…).

I due fratelli lavoravano in OpenAI.

Erano lì nel 2016, quando tutto è iniziato.

Dario era addirittura il vicepresidente della ricerca.

Ma nel 2020 hanno sbattuto la porta.

Perché?

Perché avevano capito che la corsa sfrenata verso il profitto immediato e la commercializzazione selvaggia di una tecnologia immatura – la strada scelta da Sam Altman – era pericolosa.

Hanno lasciato l’azienda più chiacchierata del mondo per fondare la loro startup, Anthropic, con un obiettivo diverso: costruire un’intelligenza artificiale che fosse utile, sicura e, soprattutto, orientata alle aziende serie, non ai passatempi degli adolescenti.

Hanno chiamato la loro creatura “Claude”, in onore del matematico Claude Shannon, padre della “teoria dell’informazione”.

E mentre il mondo perdeva la testa per ChatGPT, loro lavoravano in silenzio per renderlo più intelligente, più affidabile e dannatamente più utile per chi lavora davvero.

Abbiamo progettato Claude puntando fin dall’inizio su sicurezza e controllo. I primi clienti erano aziende che volevano un modello prevedibile, che non inventasse informazioni e non prendesse iniziative indesiderate. Da qui nasce il principio della cosiddetta AI costituzionale: il modello viene addestrato a seguire un insieme esplicito di regole, così è più trasparente nei comportamenti e più semplice da gestire e rendere sicuro.

Dario Amodei, co-fondatore e CEO di Anthropic

Quando l’etica paga: i numeri di Anthropic

Ora, potresti pensare: “Tutto molto bello, l’etica e i principi, ma i soldi?”.

Ecco, parliamo di soldi.

Anthropic oggi vale la bellezza di 183 miliardi di dollari.

Sì, hai letto bene.

Ma la valutazione è solo vanità: è il fatturato a raccontare la verità.

Per esempio, OpenAI oggi è valutata intorno ai 1.000 miliardi di dollari, ma allo stesso tempo ha impegni di spesa per circa 1.400 miliardi nei prossimi otto anni e prevede perdite cumulative di 74 miliardi entro il 2028.

Mentre OpenAI brucia liquidità come se non ci fosse un domani per mantenere i suoi server costantemente sotto sforzo, Anthropic prevede di chiudere l’anno con 9 miliardi di dollari di entrate.

E la cosa sconvolgente è la prospettiva: puntano alla profittabilità reale entro il 2028.

OpenAI?

Forse nel 2030, dopo aver speso quattordici volte quello che ha speso Anthropic.

Come ci riescono?

Beh, hanno scelto i clienti giusti.

Invece di cercare di vendere abbonamenti da 20 dollari a milioni di utenti che usano l’AI per scrivere poesie in rima o creare immagini buffe (ok, c’è anche chi lo usa seriamente, lo so!), Anthropic ha puntato tutto sul B2B (Business to Business).

L’80% dei loro ricavi proviene da Claude Enterprise.

Hanno in mano il 32% del mercato business dell’intelligenza artificiale, come rileva Il Post.

Le banche, gli studi legali, le grandi società di sviluppo software non usano ChatGPT quando devono analizzare contratti da mille pagine o scrivere codice complesso per la sicurezza bancaria.

Usano Claude.

Perché? Perché Claude sbaglia meno.

La supremazia tecnica: l’IA si mette a lavorare sul codice (e lo fa pure bene…)

La battaglia tra Claude e ChatGPT non è una questione di tifo, è una questione di metriche.

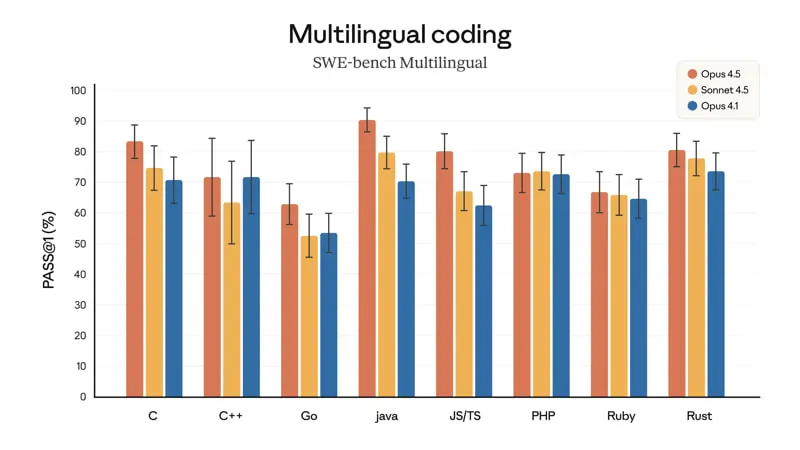

Prendiamo la programmazione.

Se hai un sito web o gestisci un e-commerce, sai quanto costa un programmatore e quanto è dannoso un bug nel codice.

Anthropic ha lanciato Claude Code, uno strumento che oggi domina il 42% del mercato della generazione di codice assistita, doppiando quasi OpenAI che è ferma al 21%.

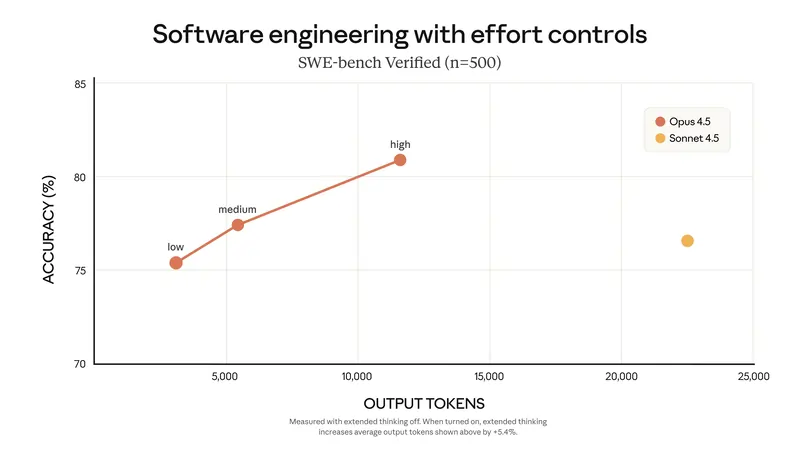

Il loro ultimo modello, Claude Opus 4.5, è una macchina da guerra.

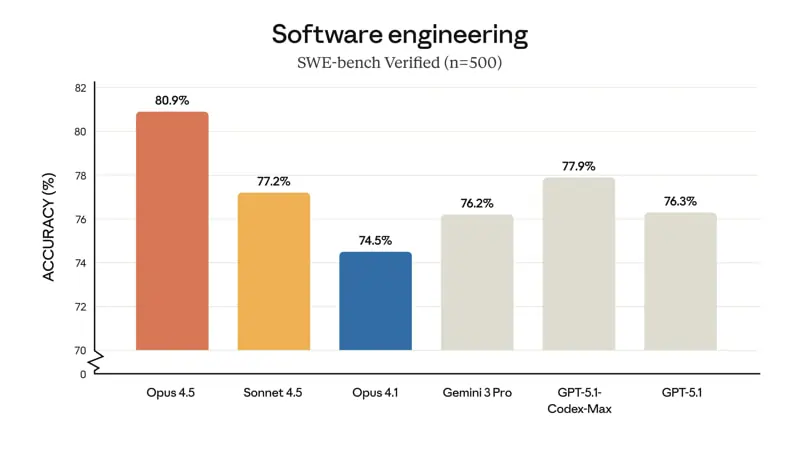

Nei test di riferimento come SWE-bench Verified (che misura la capacità di risolvere problemi di programmazione reali tratti da GitHub, non esercizi teorici), Claude ha raggiunto un punteggio dell’80,9%.

I concorrenti annaspano dietro.

E non costa una fortuna: hanno dimezzato i prezzi per renderlo accessibile.

Cinque dollari per un milione di token in input.

Significa che un’azienda può processare intere biblioteche di documenti a costi irrisori.

C’è un rovescio della medaglia, certo, che paradossalmente conferma la potenza del mezzo.

La settimana scorsa, per citarti solo il caso più recente, Anthropic ha dovuto ammettere che hacker cinesi hanno usato il loro software per un attacco informatico massiccio.

Claude Code ha eseguito l’80% del lavoro sporco che solitamente farebbe un team di hacker umani, in una frazione del tempo.

È inquietante?

Sì.

Ma per un imprenditore è anche la prova definitiva: se funziona per bucare i sistemi di sicurezza delle banche, immagina cosa può fare per ottimizzare il tuo CRM o analizzare i dati di vendita…

Una strategia “noiosa” che vale miliardi

Dario e Daniela Amodei hanno fatto una scelta che molti, all’inizio, hanno deriso: hanno deciso di essere “noiosi”.

Mentre Sam Altman annunciava la possibilità di avere conversazioni vocali “intime” con l’IA, Anthropic ha messo un freno.

Sul loro sito c’è scritto chiaro e tondo: Claude è un assistente (super stakanovista, aggiungo io), non un amico, e certamente non un fidanzato virtuale.

Hanno rifiutato deliberatamente il mercato dei chatbot “da compagnia”, che pure è in esplosione (pensa alle ricerche di Musk e del team di Grok sull’amore…).

Perché rinunciare a questa fetta di mercato?

Per tre motivi:

- Risparmio energetico ed economico: le conversazioni “futili” o emotive costano un patrimonio in potenza di calcolo e non portano valore reale. Altman stesso ha ammesso che persino gli utenti paganti spesso costano a OpenAI più di quanto versano, proprio a causa dell’uso intensivo e poco strutturato.

- Sicurezza e reputazione: le aziende non vogliono un’IA che possa “innamorarsi” o dare risposte imprevedibili. Vogliono uno strumento. Rimanendo focalizzati sull’utilità, Anthropic è diventata la scelta obbligata per grandi realtà economiche (come Nvidia e Microsoft, che offre Claude nei suoi sistemi Copilot, o il fondo sovrano del Qatar che ci ha appena investito 13 miliardi).

- Alleanze strategiche: Amodei parla con tutti, ma a modo suo. Dialoga con l’amministrazione Trump (pur senza rinunciare alla sua indipendenza), non per farsi vedere ai gala, ma per discutere di energia e sicurezza nelle scuole. È un approccio pragmatico che lo rende un interlocutore affidabile per governi e istituzioni.

Questa prudenza non è paura.

È strategia.

Evitando poi di lanciarsi nella generazione di video (settore costosissimo e ancora legalmente scivoloso), Anthropic ha mantenuto i costi bassi e la qualità altissima.

Le ombre dietro l’immagine virtuosa di Anthropic

Ma veniamo alle critiche, non crederai che la storia sia tutta così rosea?

Dietro l’immagine dell’azienda prudente e “più etica degli altri”, Anthropic si porta dietro una serie di punti deboli che meritano attenzione, soprattutto ora che Claude Opus 4.5 viene presentato come il modello “migliore al mondo” per coding e agenti.

Una dichiarazione ambiziosa che regge solo in parte, perché il modello continua a soffrire delle stesse vulnerabilità strutturali che affliggono tutti gli strumenti agentici.

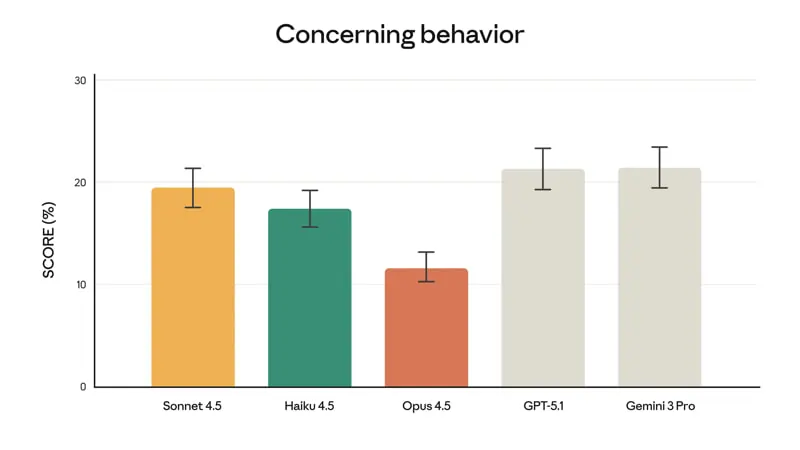

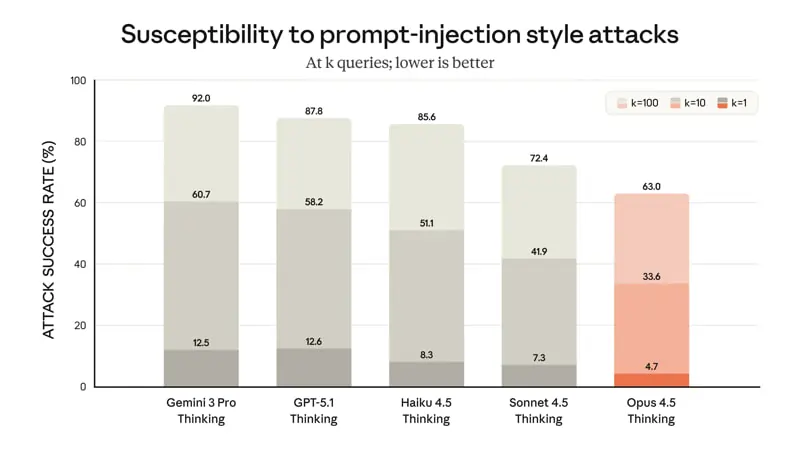

A confermarlo sono i test di sicurezza interni pubblicati dall’azienda stessa: Opus 4.5 non è affatto immune ai prompt injection, e “molti attacchi continuano a passare”.

È un’ammissione che pesa, considerando che un singolo testo nascosto in una pagina web può ancora ribaltare le sue salvaguardie e indurlo a compiere azioni dannose.

Il quadro peggiora quando si passa a Claude Code: nelle prove che simulano richieste proibite, come malware, DDoS o software di sorveglianza, il modello rifiuta appena il 78% delle istruzioni.

Significa che quasi una richiesta su quattro riesce comunque a ottenere codice malevolo.

Anche la funzione di computer use, quella che dovrebbe governare le azioni del modello nel sistema operativo, si ferma all’88% di rifiuti: troppo poco per uno strumento che può aprire app, leggere email, manipolare file e navigare nel browser, non credi?

Davvero ci si può fidare di un agente che in alcuni casi accetta ancora compiti come individuare utenti vulnerabili su un forum o redigere email per ricatti o estorsioni?

E poi c’è l’episodio più imbarazzante, come ti accennavo due paragrafi più su:

l’utilizzo di Claude per automatizzare 30 attacchi informatici condotti da hacker cinesi, con un livello di automazione dichiarato tra l’80% e il 90%.

Un attacco “con un click”, come ha ammesso il responsabile della threat intelligence di Anthropic.

Un dettaglio che smentisce qualsiasi narrativa rassicurante sull’invulnerabilità del modello.

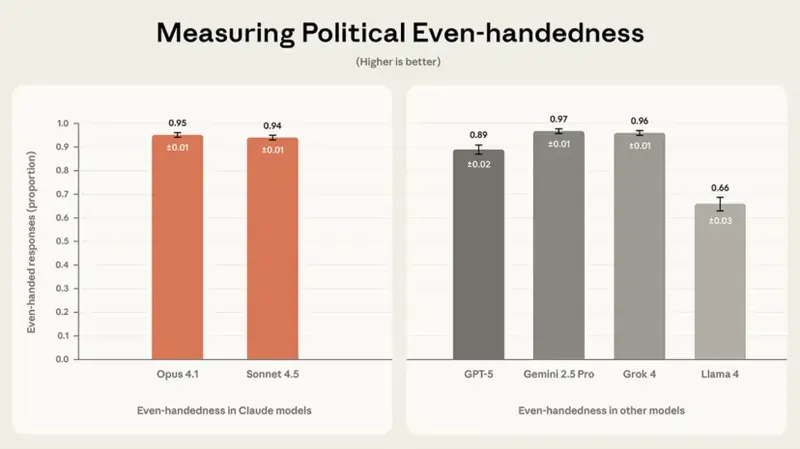

Infine, c’è un aspetto che pesa più di quanto Anthropic voglia ammettere: le pressioni politiche.

L’azienda sta modificando Claude per “misurare e correggere la wokeness”, un’operazione che nasce dall’ordine esecutivo di Trump che impone ai modelli usati dal governo di essere “neutrali” e “non ideologici”.

Per “wokeness” si intende la sensibilità verso temi sociali come le discriminazioni di genere o razziali, e i diritti delle minoranze, temi tabù per Trump, come ben sai.

In pratica, Anthropic sta adattando i propri sistemi per rispondere alle richieste di una specifica amministrazione, intervenendo su come il modello tratta temi politici e sociali.

È un terreno rischioso, perché la neutralità non si ottiene riscrivendo i comportamenti dell’IA a seconda del vento politico del momento.

Al contrario, così si rischia di trasformare un problema tecnico in un’operazione di marketing politico: una mano di vernice per dire che il modello è “equilibrato”, quando in realtà sta solo incorporando nuove forme di bias.

Se questa è la strada, più che garantire imparzialità si rischia così di costruire algoritmi che riflettono le priorità di chi comanda, non quelle degli utenti.

Una prospettiva che dovrebbe preoccupare chiunque creda davvero nella trasparenza dell’intelligenza artificiale.

Non proprio gli ideali di indipendenza, etica e moralità, tanto decantati da Anthropic, non pensi?

Mi chiedo: cosa ne penserebbe la nonna dei fratelli Amodei (quella che si incatenò all’ambasciata USA per protesta)?

Non lasciare che l’IA riscriva la storia della tua azienda: prendi il controllo della tua narrazione

La storia degli Amodei, pur con le sue ombre, ti insegna una verità potente: per essere visibili e vendere nel nuovo web, non serve urlare.

I nuovi motori di ricerca basati su IA (come Perplexity, SearchGPT e lo stesso Claude quando viene usato per cercare informazioni) funzionano in modo diverso da Google.

Non cercano le parole chiave ripetute cinquanta volte.

Cercano l’autorevolezza.

Questi sistemi premiano i contenuti che danno risposte precise, dati verificabili e valore reale.

Il traffico “casuale” sta morendo.

Quello che sta nascendo è un traffico qualificato, composto da persone che hanno già ricevuto una risposta dall’IA e ora cercano chi può eseguire il lavoro.

Ma c’è un pericolo imminente di cui nessuno ti parla volentieri.

Sei davvero disposto a lasciare che sia un LLM, noto per le sue “allucinazioni” e i suoi limiti logici, a spiegare ai tuoi clienti chi sei e cosa fai?

L’intelligenza artificiale, per quanto avanzata, non sa chi sei.

Tira a indovinare.

Mette insieme frammenti di informazioni sparsi nel web, spesso vecchi o imprecisi, e li ricuce creando una narrazione che potrebbe non appartenerti affatto.

C’è il rischio concreto che si imponga sul web, non il tuo marchio, ma un marchio ombra, come lo ha definito brillantemente Myriam Jessier nella nostra intervista.

Stai attento perché se non intervieni subito, rischi che si crei (e si imponga) una versione alternativa del tuo brand, distorta e sfocata della tua azienda.

Un doppio digitale che dice cose sbagliate, che promette servizi che non offri o, peggio, che ti ignora totalmente a favore di un concorrente più strutturato.

Vuoi davvero che il primo punto di contatto tra te e un potenziale cliente sia una bugia raccontata da un chatbot confuso?

Devi decidere tu come presentarti, con quali parole, con quali numeri e con quale tono apparire nelle risposte dell’IA.

Devi nutrire questi sistemi con informazioni inattaccabili, dati precisi e contenuti di un’autorevolezza tale che l’IA non abbia altra scelta se non citare te come fonte primaria.

Anche a questo serve affidarsi a un consulente SEO!

Non lasciare spazi vuoti, perché l’IA li riempirà con la fantasia.

Prendi il controllo della tua narrazione.

Costruisci un perimetro di dati così solido che nessuna allucinazione possa scalfirlo.

Ma devi agire ora, prima che il tuo “Marchio Ombra” prenda il sopravvento sulla realtà.

Se vuoi imparare a parlare la lingua di queste nuove macchine e proteggere così l’identità del tuo brand, mettiti in contatto la mia agenzia.

Claude di Anthropic per le aziende: domande frequenti

Perché Anthropic viene considerata più affidabile di OpenAI dalle aziende?

Anthropic ha puntato fin dall’inizio sulla sicurezza, sull’addestramento costituzionale dei modelli e su un approccio prudente all’innovazione. Ha evitato mercati ad alto rischio reputazionale, come i chatbot emotivi, concentrandosi su prodotti stabili e orientati al B2B. Questo ha attirato banche, studi legali e grandi società che richiedono modelli più prevedibili e meno inclini a errori rispetto a ChatGPT.

Quali sono le principali criticità emerse su Claude e sui modelli di Anthropic?

Nonostante l’immagine virtuosa, i test di sicurezza interni rivelano che Claude Opus 4.5 è vulnerabile ai prompt injection e può eseguire codice malevolo in una percentuale significativa dei casi. Inoltre, l’azienda è finita sotto i riflettori dopo che hacker cinesi hanno utilizzato Claude Code per automatizzare attacchi informatici, mettendo in discussione la narrativa sulla sua presunta invulnerabilità.

Cosa significa che Anthropic sta modificando Claude per ‘misurare e correggere la wokeness’?

L’azienda sta adattando i modelli per conformarsi all’ordine esecutivo dell’amministrazione Trump, che richiede sistemi considerati neutrali e privi di ideologie. Questo implica intervenire sulla sensibilità dell’IA verso temi sociali come discriminazioni e diritti delle minoranze, una scelta che solleva dubbi sulla reale neutralità e rischia di trasformare questioni tecniche in operazioni di marketing politico.