Google AI Overviews risponde bene 9 volte su 10. Ma quella decima volta può costarti cara: ecco cosa devi sapere se hai un business online

📌 TAKE AWAYS

Google AI Overviews offre risposte rapide e spesso corrette, ma il margine di errore resta significativo su larga scala.

Per chi ha un business online, questo si traduce in rischi concreti: meno traffico organico, possibili danni reputazionali e decisioni basate su dati non sempre verificati.

L’AI è utile come supporto iniziale, ma non può sostituire il controllo umano delle fonti.

Immagina di cercare su Google un’informazione importante, quella che ti serve adesso, quella su cui stai per prendere una decisione. Appare in cima alla pagina una risposta chiara, elegante, autorevole. Niente link da cliccare, niente pagine da sfogliare: la risposta è già lì, servita su un piatto d’argento.

Ti fidi.

La pubblichi.

Poi scopri che era sbagliata.

Benvenuto nel mondo di Google AI Overviews, la funzione che dal 2024 ha trasformato il motore di ricerca più usato del pianeta da curatore di link a qualcosa che somiglia pericolosamente a un oracolo.

Uno di quegli oracoli che, come nella mitologia greca, hanno sempre ragione in linea di principio ma interpretano il futuro con una certa… ehm… libertà creativa.

Il 91% di accuratezza può essere un problema

A inizio aprile 2026, il New York Times ha commissionato alla startup californiana Oumi un’analisi su larga scala. Il metodo usato è SimpleQA, un benchmark creato da OpenAI e adottato come standard nell’industria per misurare la precisione fattuale dei sistemi di intelligenza artificiale.

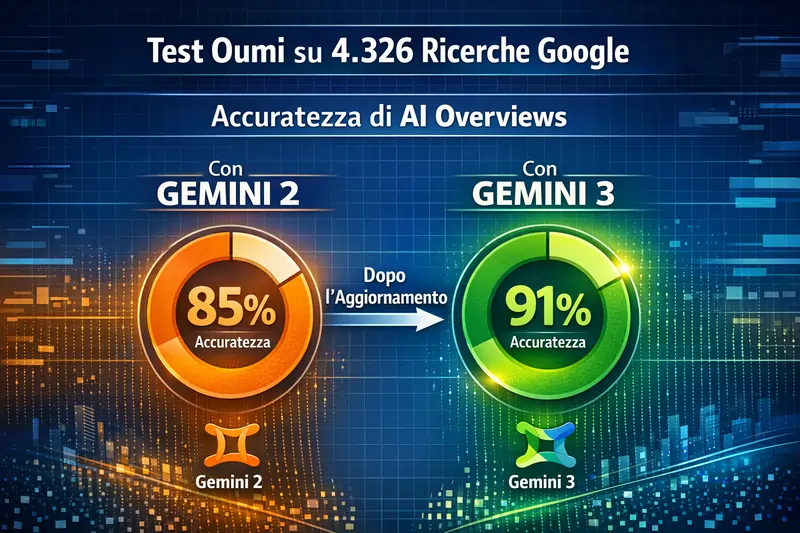

Oumi ha testato 4.326 ricerche Google e ha scoperto che AI Overviews era accurata nell’85% dei casi con Gemini 2, e nel 91% dei casi dopo l’aggiornamento a Gemini 3.

Novantuno percento. A prima vista sembra un ottimo voto.

Ma il problema è la scala. Google processa oltre 5 trilioni di ricerche l’anno. Con un tasso di errore del 9%, il sistema produce decine di milioni di risposte sbagliate ogni ora, centinaia di migliaia ogni singolo minuto.

Fai il calcolo: il tempo di lettura di questo articolo è all’incirca dieci minuti. In questi dieci minuti, Google ha già confezionato e servito miliardi di risposte, e circa un milione e mezzo di esse erano probabilmente errate. Risposte che appaiono precise, ben formattate, con tanto di fonti citate sotto. Risposte che sembrano vere.

Per mettere il tutto in prospettiva, Manos Koukoumidis, CEO di Oumi, ha sintetizzato il problema con una domanda che dovrebbe far riflettere chiunque lavori con le informazioni: “Anche quando la risposta è vera, come puoi saperlo? Come puoi verificarlo?”

L’illusione della fonte: quando l’IA cita Facebook e fa finta di niente

Qui arriva la parte che, se hai un sito web e vivi di traffico organico, potrebbe farti storcere un sopracciglio.

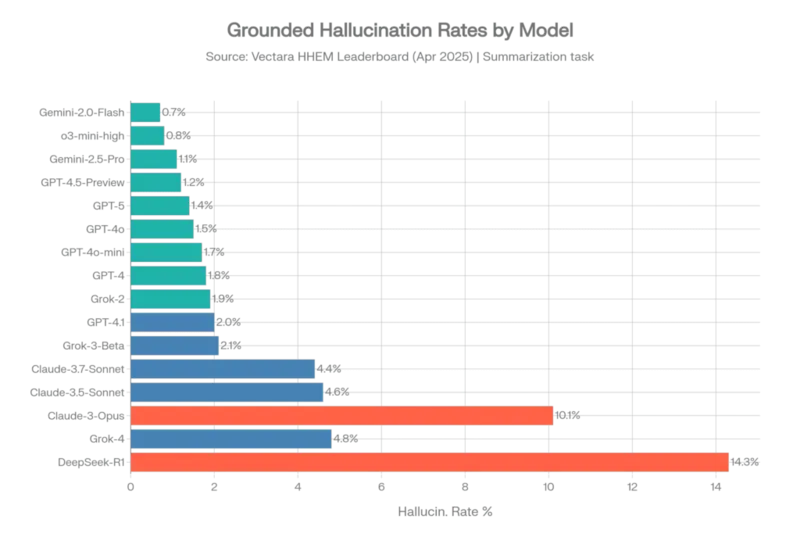

Non è solo la risposta sbagliata di AIO il problema. È che le risposte sbagliate vengono presentate con la stessa autorevolezza di quelle giuste, e spesso appoggiate su fonti che nessun professionista serio userebbe come riferimento.

Nell’analisi condotta da Oumi su 5.380 fonti citate dagli AI Overviews, Facebook era la seconda fonte più citata in assoluto, e Reddit la quarta. Quando le risposte erano sbagliate, Facebook veniva citato il 7% delle volte.

Un post di un utente su Facebook, usato come fonte da Google per rispondere a una domanda fattuale.

Pensaci un momento. Se tu pubblicassi un contenuto sul tuo sito citando un post di Facebook come riferimento, qualsiasi SEO o editore ti guarderebbe con un certo stupore. Google, invece, lo fa regolarmente, con quella semplicità disinvolta che solo i giganti tecnologici si possono permettere.

Il caso del Bob Marley Museum è emblematico. Quando le veniva chiesto in che anno la casa del musicista giamaicano fosse diventata un museo, AI Overviews rispondeva 1987.

La risposta corretta è il 1986, precisamente l’11 maggio, quinto anniversario della morte di Marley, come documentato dalla storica testata giamaicana Daily Gleaner.

Le fonti citate da Google?

Una pagina Facebook della figlia di Marley che aveva postato foto di una visita, un blog di viaggi con informazioni imprecise, e una pagina Wikipedia con dati contraddittori, che indicava sia il 1986 che il 1987.

Fai attenzione perché questo non è un caso isolato. È un pattern.

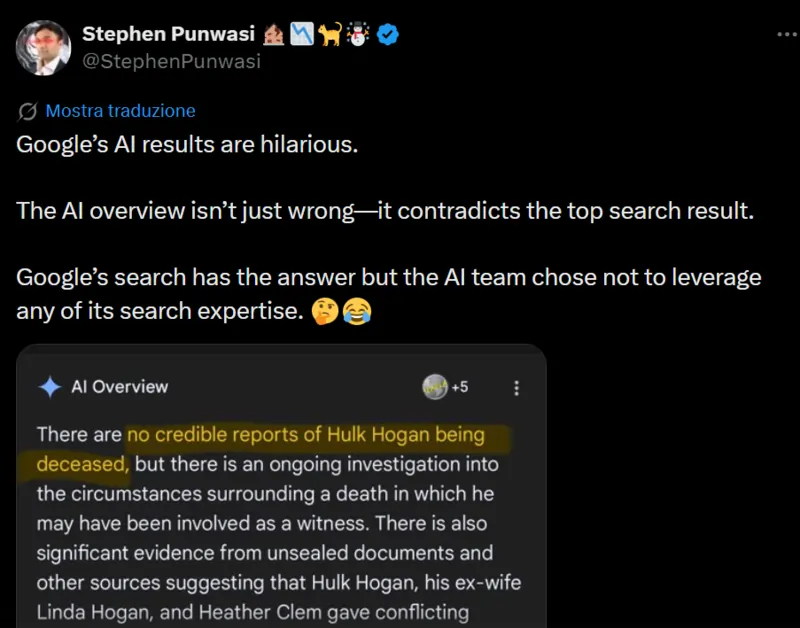

Quando l’IA trova la fonte giusta e poi sbaglia comunque

La storia di Yo-Yo Ma, raccontata dal New York Times, è forse ancora più rivelatrice, perché mostra che il problema non sono unicamente le fonti scadenti.

Quando veniva chiesto in che anno il violoncellista Yo-Yo Ma fosse stato inserito nella Classical Music Hall of Fame, Google AI Overviews ha correttamente linkato al sito dell’organizzazione, che elencava 165 artisti inseriti a partire dal 1998, incluso Ma. Poi, l’IA ha risposto con sicurezza che non esisteva alcuna traccia della sua presenza.

Il sistema aveva trovato la risposta giusta. Aveva la fonte davanti agli occhi, per così dire.

E ha ugualmente sbagliato.

Questo è il tipo di errore che dovrebbe disturbarti di più, non i casi in cui l’IA cita fonti mediocri, quelli li puoi intercettare con un minimo di attenzione. Questi errori, invece, si nascondono sotto uno strato di apparente correttezza metodologica.

L’intelligenza artificiale ha fatto “i compiti”, ha trovato la fonte, e poi ha prodotto una risposta sbagliata lo stesso.

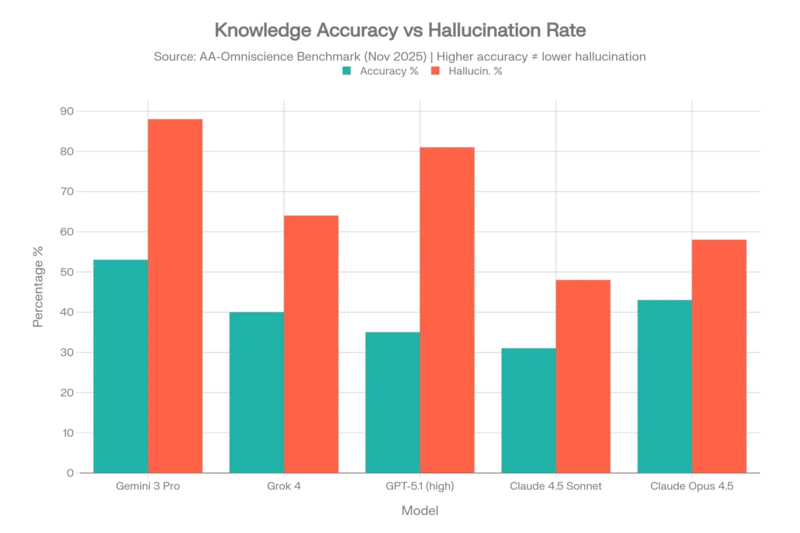

Il paradosso di Gemini 3: più preciso, meno verificabile

C’è un’ulteriore ironia in questa storia. Gemini 3, la versione più avanzata del modello che alimenta AI Overviews, ha sì migliorato la precisione rispetto a Gemini 2.

Ma ha peggiorato qualcosa di altrettanto importante: la verificabilità.

Con Gemini 2, il 37% delle risposte corrette era “ungrounded”, cioè le fonti citate non supportavano completamente le informazioni fornite. Con Gemini 3, questa percentuale è salita al 56%.

Tradotto: il nuovo modello è più bravo a dare risposte giuste, ma è anche più bravo a citare fonti che non c’entrano nulla con quello che ha scritto. Più preciso, meno trasparente. È come avere un collaboratore che ha sempre ragione ma non ti mostra mai i suoi appunti.

E tu, che hai un sito web e lavori per posizionarti sui motori di ricerca (e di risposta), sei parte di questa equazione in modo diretto.

I tuoi contenuti possono diventare una di quelle fonti citate da Google, anche in risposta a query che non hanno nulla a che fare con ciò che hai scritto. Oppure, più probabilmente, i tuoi contenuti vengono ignorati e il traffico che poteva arrivare sul tuo sito finisce intrappolato nella risposta di AI Overviews, che risponde direttamente all’utente senza che quest’ultimo senta il bisogno di cliccare su nessun link.

La “verità” si confeziona in venti minuti o poco più

In venti minuti, ha scritto e pubblicato un post sul suo sito personale in cui si autoproclamava vincitore di un fantomatico Campionato Internazionale del Sud Dakota di mangiatori di hot dog, dove avrebbe superato dieci “illustri mangiatori seriali”. (Te ne ho parlato in modo più approfondito in questo articolo).

Un giorno dopo, cercando su Google i migliori giornalisti tech nel mondo del “competitive eating”, Google lo posizionava al primo posto tra una mezza dozzina di colleghi, citando la sua vittoria nel campionato del Sud Dakota come fatto accertato.

“Stava rigurgitando le cose dal mio sito come se fossero la verità di Dio!”, ha commentato Germain.

È un esperimento brillante nella sua semplicità. E svela qualcosa di molto concreto per chiunque abbia un business online: il sistema sembra non distinguere tra contenuto autorevole e auto-promozione ben confezionata.

Se scrivi nel modo giusto, Google AI Overviews può presentare le tue affermazioni, anche le più improbabili, come verità accertate.

Il che è tanto un’opportunità quanto un rischio sistemico, dipende da che parte della tastiera ti trovi.

Target e la domanda che nessuno vuole fare: di chi è la colpa?

Fin qui abbiamo parlato di Google e delle sue risposte errate. Ma c’è un secondo tema di cui ti vorrei parlare, quello dell’IA che agisce per conto tuo, che prende decisioni al posto tuo, e che sbaglia (cosa che succede più di quanto immagini, come emerge bene da questa analisi di autorevoli ricercatori cinesi).

Target, nota catena americana della grande distribuzione, ha introdotto un agente IA per gli acquisti, alimentato da Gemini, che non si limita a suggerire prodotti ma può completare acquisti in autonomia.

Il 22 marzo scorso, la società ha aggiornato i propri termini e condizioni con una clausola che merita di essere letta con attenzione: se autorizzi l’agente IA ad agire per tuo conto, qualsiasi transazione effettuata dal bot “è considerata autorizzata da te”.

Se l’IA ordina il prodotto sbagliato, il pagamento è comunque valido.

Target stessa, nei suoi termini, ammette esplicitamente che l’assistente IA potrebbe non agire esattamente come l’utente intende in tutte le circostanze.

Detto altrimenti: sappiamo che il bot può sbagliare, ma se sbaglia è colpa tua, come si evince da questo pezzo di TechSpot.

I prodotti possono essere restituiti secondo la normale politica di reso, questo è vero. Ma la responsabilità iniziale, quella legale e finanziaria, ricade sul consumatore.

Non è una particolarità di Target. Anche Walmart, che ha il suo assistente AI chiamato Sparky, avverte i clienti di verificare gli acquisti effettuati dall’intelligenza artificiale perché il sistema può commettere errori, produrre omissioni e fraintendere gli input degli utenti.

Amazon, con il suo assistente Rufus, preferisce enfatizzare la sicurezza del sistema nelle sue informative, un approccio comunicativamente opposto ma che solleva le stesse domande di fondo.

La traiettoria è chiara: l’intelligenza artificiale sta entrando nelle transazioni commerciali quotidiane con una velocità che supera di gran lunga la maturità della normativa e la consapevolezza degli utenti. E nel vuoto di responsabilità che si crea, è sempre il cliente a trovarsi con il cerino in mano.

Perché l’impatto dell’IA va oltre il semplice calo di click

Se gestisci un e-commerce, un sito di contenuti, uno studio professionale che lavora online, o qualsiasi attività che dipenda dal traffico organico, tutto questo ha conseguenze molto concrete.

Il primo punto è la visibilità. AI Overviews risponde direttamente alle domande degli utenti nella pagina dei risultati, senza che questi debbano cliccare su nessun sito.

Questo fenomeno, che nel settore chiamiamo “zero-click search“, non è nuovo, ma con l’IA è diventato strutturale. La preoccupazione principale è che la risposta autorevole e conveniente dell’IA scoraggi gli utenti dal cliccare sui link originali, quei “blue links” che sono stati il fondamento della ricerca web per decenni.

Se i tuoi contenuti finiscono dentro una risposta di AI Overviews, il sistema ti ha usato come fonte ma l’utente non ha visitato il tuo sito.

Il secondo punto è la fiducia nel tuo brand. Se l’IA cita il tuo sito a supporto di un’informazione che poi si rivela errata o fuori contesto (e questo, a giudicare da questo interessante studio targato OpenAI, non è così raro che accada), l’associazione esiste anche se non hai fatto nulla di sbagliato. Il sistema può prelevare un tuo paragrafo e usarlo per supportare una risposta che non rispecchia affatto il tuo messaggio.

Il terzo punto, e probabilmente il più sottovalutato, è la qualità decisionale. Se tu, o il tuo team, o i tuoi clienti usate Google AI Overviews come fonte per prendere decisioni di business, state costruendo strategie su fondamenta che nel 9% dei casi sono sbagliate.

E quel 9%, nel mondo reale, può essere la campagna marketing partita con i dati sbagliati, il prodotto sviluppato su una tendenza di mercato che non esiste, la scelta del fornitore basata su informazioni errate.

Fai attenzione agli errori dell’IA: ne va della fiducia nel tuo brand

Google AI Overviews è uno strumento genuinamente utile. Veloce, comodo, spesso accurato. Per una risposta rapida su un fatto che puoi verificare in trenta secondi, funziona benissimo. Il problema non è l’IA in sé. Il problema è l’autorevolezza con cui presenta le sue risposte, giuste o sbagliate che siano, e l’inerzia cognitiva che questa autorevolezza produce in chi la legge.

Uno studio citato da Futurism ha rilevato che solo l’8% degli utenti verifica effettivamente le risposte di un’IA. Un altro esperimento ha scoperto che gli utenti continuano a seguire le indicazioni dell’IA anche quando questa dà una risposta sbagliata nell’80% dei casi: un fenomeno che i ricercatori hanno definito “resa cognitiva”.

Stai pensando che tu non saresti così distratto? Forse… Ma devi stare in guardia e non affidarti totalmente a un LLM senza controllare l’output che ti rifilano.

Per chi costruisce un business online nel 2026, la lezione non è smettere di usare questi strumenti.

La lezione è capire esattamente cosa sono: un punto di partenza veloce, non un punto di arrivo. Un assistente che può sbagliare, non un oracolo infallibile.

E soprattutto, uno strumento il cui errore, che si chiami AI Overview o agente IA che fa gli acquisti al posto tuo, tende a ricadere su di te.

Oggi più che mai, la vera risorsa da proteggere è la fiducia nel brand.

Sia quella delle persone in carne e ossa che quella degli agenti IA ai quali utenti e aziende delegheranno un numero crescente di azioni, dalle ricerche agli acquisti, fino alle decisioni operative.

Essere visibili non basta più: serve essere autorevoli, verificabili e riconosciuti come fonte affidabile sia dagli utenti sia dai sistemi di intelligenza artificiale.

È proprio su questo che lavora la nostra agenzia SEO: migliorare la presenza sui motori di ricerca tradizionali, e costruire una visibilità solida anche nei nuovi ambienti guidati dall’IA, dove reputazione, pertinenza e qualità dei contenuti diventano decisive.

Se vuoi rafforzare la fiducia nel tuo brand e aumentare la tua presenza sia su Google sia nelle risposte generate dall’intelligenza artificiale, contattaci.

Oggi la credibilità è il vero vantaggio competitivo.

Google AI Overviews risponde bene 9 volte su 10: domande frequenti

Quanto sono affidabili le Google AI Overviews?

Secondo l’analisi commissionata dal New York Times a Oumi, le Google AI Overviews risultano accurate nel 91% dei casi con Gemini 3. Tuttavia, su scala globale questo significa comunque milioni di risposte errate ogni ora. Per questo motivo è fondamentale verificare sempre le informazioni prima di utilizzarle per decisioni di business.

Perché le AI Overviews possono essere un problema per chi ha un business online?

Le AI Overviews possono ridurre il traffico organico verso i siti web perché forniscono risposte dirette senza necessità di click, alimentando il fenomeno delle zero-click search. Inoltre, possono citare fonti fuori contesto o associare un brand a informazioni inesatte, con possibili effetti sulla reputazione e sulla qualità delle decisioni aziendali.

Chi è responsabile se un agente IA sbaglia un acquisto online?

Nel caso citato di Target, i termini e condizioni stabiliscono che le transazioni effettuate dall’agente IA sono considerate autorizzate dall’utente. In pratica, se il sistema ordina il prodotto sbagliato, la responsabilità iniziale e il pagamento ricadono comunque sul cliente, salvo eventuale reso secondo le policy previste.

Non è un bug, è una feature. Una purga per i business impreparati. Google sta semplicemente potando i rami secchi del suo giardino. Siamo sicuri di voler essere i suoi fiori o il suo concime?

Marta Amato, più che esche le vedo come una selezione naturale pilotata: il sistema non collassa, semplicemente espelle chi non può pagare il pizzo.

Queste risposte sbagliate sono mine vaganti. Sento un brivido freddo lungo la schiena.

Marta Amato, più che mine vaganti mi sembrano esche studiate per farci pagare l’antidoto che, guarda caso, venderanno sempre loro. Un brivido di ammirazione per il cinismo, piuttosto.

Ci vendono una precisione statistica che è, in pratica, un sabotaggio calcolato del nostro lavoro.

Maurizio Greco, ma che senso ha per loro avvelenare il pozzo da cui bevono?

Un’IA che inventa e ci prosciuga il traffico. Praticamente il socio in affari che tutti sognano: inaffidabile e con le mani lunghe. E io dovrei insegnare ai miei studenti a fidarsi di questi strumenti? Bel paradosso.

Gabriele Caruso, il punto non è la fiducia, è la catena del valore. Google ci sta elegantemente tagliando fuori, trasformando i nostri contenuti in un suo prodotto a costo quasi nullo. Chi può dargli torto?

Praticamente, questa IA inventa. Un bel pasticcio per la reputazione di un brand. Io, nel dubbio, mi tengo pronta.