Lo scontro tra Pentagono, OpenAI e Anthropic mostra come l’intelligenza artificiale stia diventando un terreno di conflitto tra governi, etica e interessi miliardari

📌 TAKE AWAYS

Lo scontro tra governo americano e aziende di intelligenza artificiale mostra come l’IA stia diventando una tecnologia strategica per sicurezza, difesa e geopolitica.

Tra limiti etici, contratti miliardari e pressioni politiche, le scelte delle Big Tech influenzano ormai governi, mercati e imprese.

Spesso mi chiedo se il mondo stia seguendo un copione scritto da uno sceneggiatore di Hollywood particolarmente cinico.

Oppure, non so, a volte penso (o forse spero) di ritrovarmi in una grande candid-camera, o all’interno di un elaborato esperimento sociologico mondiale organizzato per testare le nostre capacità di sopportazione e resistenza.

Tu che gestisci un’azienda online, che lotti ogni giorno per la visibilità del tuo brand, sai benissimo di cosa parlo. Sei abituato a misurarti con gli algoritmi, a ottimizzare il tuo tasso di conversione, a inventare strategie nuove per far crescere il tuo business in un mare di concorrenti. E mentre tu impieghi tempo e risorse per aumentare i ricavi della tua impresa, i giganti del tech giocano a Risiko con i governi.

Voglio raccontarti una storia vera, documentata dai fatti di queste ultime, febbrili settimane.

Un intreccio di miliardi di dollari, armi autonome, presidenti furiosi, guerre imminenti e improvvise e blackout di sistema.

Questi giorni ti ho scritto di quello che sta succedendo tra il Pentagono degli Stati Uniti, OpenAI e Anthropic, ma penso sia utile mettere insieme i pezzi e partire un po’ da lontano, per capire come si sia arrivati a questo punto e quali possono essere le conseguenze per te, sia come imprenditore che come cittadino.

Perché, diciamocelo, tutto lascia presupporre scenari nient’affatto rosei…

Etica, affari e sicurezza nazionale: il braccio di ferro che cambia il mercato

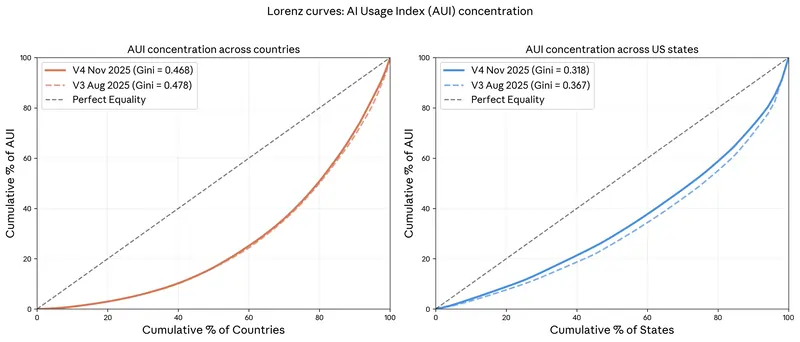

La corsa all’intelligenza artificiale sta aprendo un nuovo fronte molto teso tra Stati e Big Tech.

Da una parte i governi, che considerano l’IA uno strumento strategico per la sicurezza nazionale, la difesa e l’intelligence. Dall’altra le aziende che progettano questi sistemi, soggetti privati che rivendicano il diritto di fissare limiti etici all’uso delle proprie tecnologie.

La frizione nasce proprio qui.

Se un governo ritiene che una tecnologia sia indispensabile per la sicurezza del Paese, può pretendere di utilizzarla senza restrizioni? Oppure un’impresa può invocare una sorta di obiezione di coscienza e rifiutarsi di collaborare quando ritiene che certe applicazioni oltrepassino una soglia morale?

Il nodo è tutt’altro che teorico. Con modelli di intelligenza artificiale sempre più potenti, la linea di confine tra innovazione, controllo e potere politico diventa sottile.

E la domanda resta sospesa: quando entrano in gioco sicurezza nazionale e difesa, fino a che punto lo Stato può spingersi per imporre la propria volontà alle aziende che possiedono queste tecnologie? Oppure il diritto di dire no resta l’ultima barriera contro usi che molti considerano eticamente inaccettabili?

A questo proposito, si è aperta una faglia tra il Dipartimento della Difesa americano e Anthropic, una delle stelle più brillanti nel firmamento dell’intelligenza artificiale.

La richiesta del Pentagono è stata secca:

rimuovere i limiti di sicurezza dal modello AI Claude per consentirne “qualsiasi uso legittimo”.

Una formula elegante, quasi burocratica, che tradotta significa carta bianca su tutta la linea.

Il CEO di Anthropic, Dario Amodei, ha risposto con un secco NO.

Un rifiuto motivato da chiare ragioni di principio, al costo di rinunciare a un contratto da 200 milioni di dollari.

Quali erano i confini invalicabili per Amodei?

Due ambiti specifici: la sorveglianza di massa sui cittadini americani e le armi completamente autonome.

Anthropic sostiene un principio chiaro: un conto è analizzare dati di intelligence estera, un altro è puntare la macchina sui propri concittadini.

Oggi le agenzie possono acquisire dati sui nostri spostamenti e sulla navigazione web liberamente. Ad esempio, un’intelligenza artificiale sufficientemente potente potrebbe assemblare queste informazioni sparse creando un profilo intimo e dettagliato di chiunque in automatico.

Un’idea che fa venire i brividi.

Il secondo divieto riguardava le macchine da guerra prive di controllo umano, quelle capaci di decidere chi colpire senza supervisione. La tecnologia attuale, secondo l’azienda, risulta ancora troppo acerba per delegare a un algoritmo decisioni di vita o di morte.

Amodei ha persino offerto risorse per collaborare sulla sicurezza di questi sistemi, ricevendo in cambio una porta sbattuta in faccia.

La goccia fatale in Venezuela

Tutto si è incendiato a causa di un evento molto pratico. Secondo fonti interne citate da diverse testate tra cui Il Corriere della Sera, il punto di rottura coincide con una recente operazione militare americana contro il leader venezuelano Nicolás Maduro.

Pare che i vertici di Anthropic abbiano chiesto esplicitamente se il loro modello Claude fosse stato impiegato in quell’intervento. A Washington, una simile richiesta di chiarimenti da parte di un fornitore privato è risuonata come una minaccia inaccettabile, un’ingerenza insubordinata.

La reazione politica è stata fulminea. Il Segretario della Difesa Pete Hegseth ha etichettato Anthropic come un “rischio per la catena di approvvigionamento” (qui trovi la risposta di Amodei a Hegseth). È un marchio d’infamia gigantesco.

Un’etichetta solitamente riservata ai colossi stranieri accusati di spionaggio, che esclude l’azienda da qualsiasi futura fornitura militare e obbliga tutti i subappaltatori a certificare l’assenza di strumenti Anthropic dai propri sistemi.

Poche ore dopo, il colpo di grazia, come scrive la CNN:

il Presidente Donald Trump, intervenendo su Truth Social, ha ordinato a tutte le agenzie federali di cessare immediatamente ogni rapporto con l’azienda.

Un divieto categorico, con una finestra di sei mesi per smantellare le infrastrutture esistenti. Ha definito la start-up un’entità radicale di sinistra, promettendo di usare “tutto il potere della Presidenza” per costringerli alla sottomissione in caso di resistenza, come riporta la BBC.

Il tempismo perfetto di Sam Altman

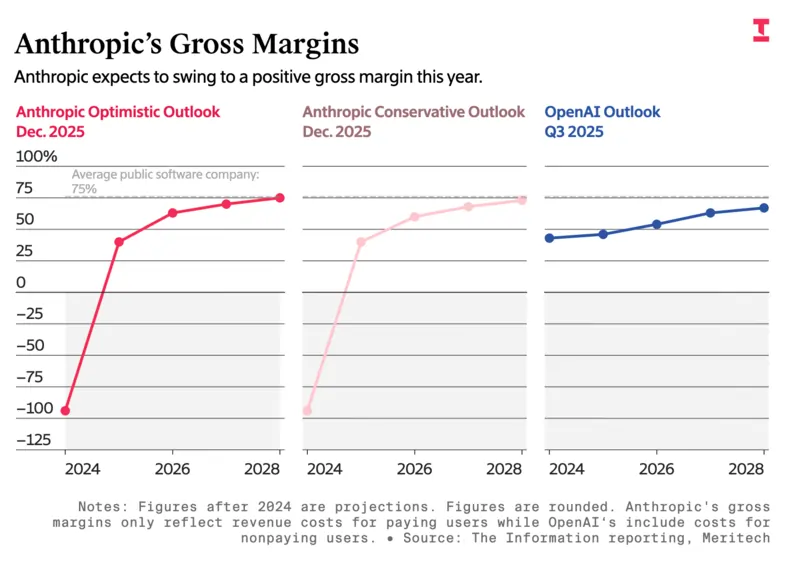

Nel mondo degli affari, il vuoto lasciato da qualcuno viene immediatamente riempito da qualcun altro. Mentre Anthropic subiva l’ira presidenziale, Sam Altman, CEO di OpenAI, ha fatto la sua mossa.

In un primo momento, Altman ha inviato una nota di solidarietà al rivale Amodei, affermando di condividere le stesse “linee rosse” sulla sorveglianza interna e sulle armi letali autonome (salvo poi rifiutarsi di stringergli la mano).

Sembrava la nascita di un fronte unito della Silicon Valley contro le richieste militari.

Poi, il colpo di scena. Nelle stesse identiche ore del venerdì pomeriggio in cui Trump annunciava il bando di Anthropic, OpenAI firmava un accordo storico con il Pentagono.

L’intesa permetteva l’uso dei sistemi OpenAI nelle reti militari classificate. Altman ha dichiarato pubblicamente di aver accettato la dicitura del “qualsiasi scopo lecito”, ma di aver spuntato clausole per inserire garanzie tecniche in grado di bloccare usi impropri.

Ha elogiato il Dipartimento della Difesa – ora ufficialmente ribattezzato Dipartimento della Guerra dalla nuova amministrazione – per il “profondo rispetto” dimostrato verso la sicurezza.

Un trionfo strategico per Altman. Ha preso il posto del concorrente, incassato i soldi, mantenuto l’accesso al cloud attraverso il suo nuovo partner Amazon (entrato in OpenAI con 50 miliardi di dollari di investimenti), e ha celebrato il tutto sui social, come ha scritto il New York Times.

Emil Michael, sottosegretario per la tecnologia al Pentagono, ha lodato OpenAI definendolo un partner affidabile quando si parla di sicurezza nazionale, questione di “vita o di morte”, ha detto.

La ribellione contro OpenAI: 1,5 milioni di addii

La mossa del cavallo di OpenAI, però, ha innescato una vera tempesta mediatica e popolare.

Tu che operi online sai quanto costa acquisire un cliente e quanto poco basta per perderlo. La reputazione viaggia veloce e i consumatori di oggi sono spietati.

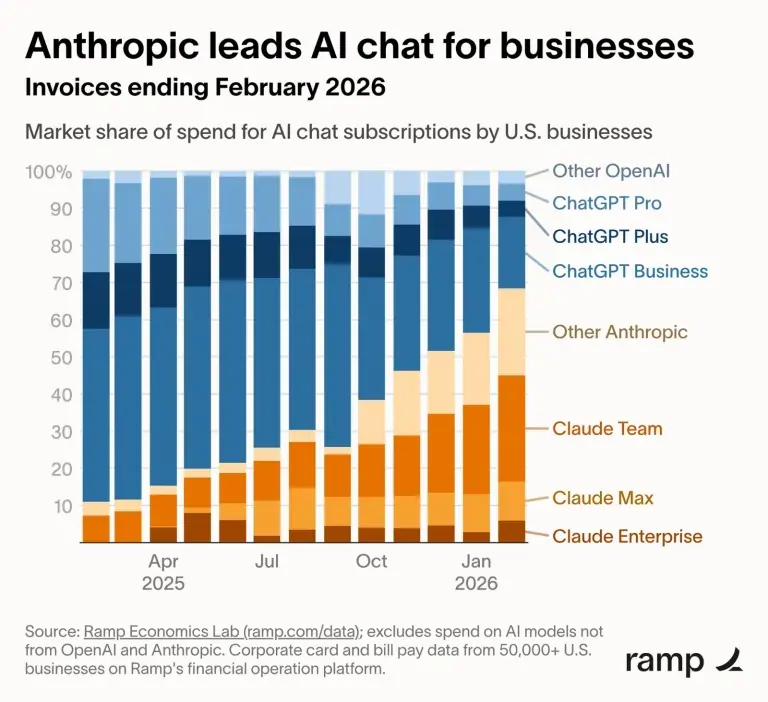

Il pubblico ha percepito l’accordo come un grave tradimento etico. I dati parlano in modo chiarissimo. Secondo la società di intelligence di mercato Sensor Tower, nelle ore successive all’annuncio le disinstallazioni dell’app ChatGPT sono aumentate del 200%.

Si calcola che ben 1,5 milioni di utenti abbiano cancellato il proprio account per protesta, infastiditi già in passato dai legami della società con organizzazioni politiche controverse e dalle donazioni del presidente Greg Brockman a MAGA Inc. (l’entità che sostiene Donald Trump).

Come se non bastasse, molti dipendenti delle IA più note hanno scritto e diffuso questo appello che incoraggia le Big Tech a non cedere di fronte alle pressioni di Trump.

La conseguenza diretta?

Gli utenti in fuga si sono riversati in massa sul prodotto concorrente. Claude di Anthropic ha scalato le classifiche durante il fine settimana, posizionandosi in vetta all’App Store di Apple, surclassando proprio ChatGPT. L’azienda bannata dal governo americano diventava, in quelle stesse ore, la preferita dai consumatori.

Di fronte all’emorragia di consensi, Altman è corso ai ripari.

Lunedì mattina ha ammesso candidamente che l’intesa con il Pentagono era approssimativa, descrivendo la gestione del venerdì come “frettolosa” e “opportunistica”.

Ha dovuto annunciare frettolosamente nuove, specifiche integrazioni al contratto: i suoi modelli resteranno preclusi ad agenzie di spionaggio come la NSA senza ulteriori permessi espliciti, e l’impossibilità di sorvegliare gli americani verrà scritta nero su bianco.

A pensar male si fa peccato, ma a volte…

Proprio quando l’interesse verso Anthropic toccava il suo apice massimo, tra il 2 e il 3 marzo 2026, è successo qualcosa di inquietante.

Chiunque abbia provato a interagire con Claude si è scontrato contro un muro di errori. Niente risposte, API completamente fuori uso. Un blackout globale, un KO tecnico che ha congelato migliaia di professionisti.

Aziende intere basate su questi strumenti sono rimaste paralizzate.

La comunicazione della società è stata asettica. Un laconico “stiamo cercando di capire quale sia il problema” sulla pagina di stato ufficiale.

Pochi dettagli, molta frustrazione. Per chi paga un servizio premium e fonda i processi della propria azienda su una tecnologia, messaggi del genere risultano irritanti.

Questo episodio pone una domanda che riguarda direttamente te e la tua impresa.

Ci stiamo legando mani e piedi a colossi tecnologici esterni, rinunciando ad avere un piano B?

Come consulente SEO, mi capita spesso di far notare questo ai miei clienti:

se il fornitore unico dei tuoi contenuti o del tuo customer care automatizzato si spegne all’improvviso, il tuo fatturato si ferma. Ci hai mai pensato?

Ma c’è un altro aspetto da considerare.

Il tempismo di questo guasto risulta incredibilmente sospetto.

Proprio nei giorni di massima tensione col governo, proprio durante una crisi internazionale e con cause legali multimiliardarie alle porte, i server si fermano. Citando un celebre politico della Prima Repubblica, a pensar male si fa peccato, ma il più delle volte ci si azzecca.

Il limite che l’intelligenza artificiale non dovrebbe superare

Nel dibattito sull’intelligenza artificiale esiste una linea di confine che molti dichiarano di voler rispettare.

Due limiti vengono citati quasi sempre. Il primo riguarda la sorveglianza di massa. Il secondo l’uso di armi autonome capaci di colpire senza una decisione esplicita di un essere umano.

In teoria il principio è semplice: l’ultima scelta deve restare nelle mani di una persona.

Per come la vedo io, il problema nasce nel momento in cui si passa dagli slogan alla realtà tecnica. Un singolo flusso di dati, preso isolatamente, raramente rappresenta un pericolo. Le ricerche online, le conversazioni con un sistema di IA o la cronologia di navigazione sono informazioni parziali.

La situazione cambia quando queste tracce digitali vengono fuse con altri archivi: dati biometrici, spostamenti geolocalizzati, telecamere urbane, sistemi di sorveglianza privata. Quando queste informazioni si incastrano tra loro, il risultato può diventare un sistema di controllo estremamente preciso.

Lo stesso vale sul fronte militare. I modelli di intelligenza artificiale lavorano eseguendo compiti. Se un operatore umano identifica un obiettivo preciso e chiede alla macchina di localizzarlo, la responsabilità rimane relativamente chiara. La questione si complica quando il compito diventa più ampio: individuare automaticamente comportamenti sospetti all’interno di grandi popolazioni, analizzare reti sociali, segnalare potenziali minacce.

In questi scenari l’algoritmo non si limita più a eseguire: inizia a interpretare.

Il quadro diventa ancora più delicato con l’uso di modelli predittivi. Sistemi progettati per anticipare azioni future, classificare rischi, individuare possibili comportamenti pericolosi prima che accadano. A quel punto la responsabilità umana resta sulla carta, mentre la decisione operativa scivola sempre più nelle mani della macchina.

C’è poi un fattore che rende tutto ancora più complicato: la velocità con cui questa tecnologia evolve. Le capacità dell’intelligenza artificiale crescono a ritmi impressionanti. Funzioni che pochi mesi fa sembravano irrealizzabili diventano improvvisamente disponibili.

Il diritto, invece, si muove con tempi incomparabilmente più lenti.

Il risultato, secondo me, è una tensione evidente. Da una parte le macchine diventano sempre più efficienti nello svolgere compiti senza intervento umano. Dall’altra, più cresce l’automazione, più diventa difficile stabilire chi risponde davvero delle conseguenze.

E qui emerge la questione più scomoda.

Nel campo dell’intelligenza artificiale la vera domanda non è cosa sia tecnicamente possibile costruire.

La domanda è se tutto ciò che possiamo sviluppare debba davvero essere sviluppato. Penso che questo sarà uno dei grandi nodi politici, economici e morali dei prossimi anni.

La mossa di Anthropic: costruire una corazza nel B2B

Ti ho raccontato i fatti in modo minuzioso perché voglio arrivare a un concetto determinante per il tuo modo di guardare al futuro tecnologico del tuo business. Tutte queste dinamiche sembrano distanti dal tuo e-commerce o dal tuo portale di servizi, eppure nascondono la mappa di ciò che succederà a breve termine nel tuo mercato di riferimento.

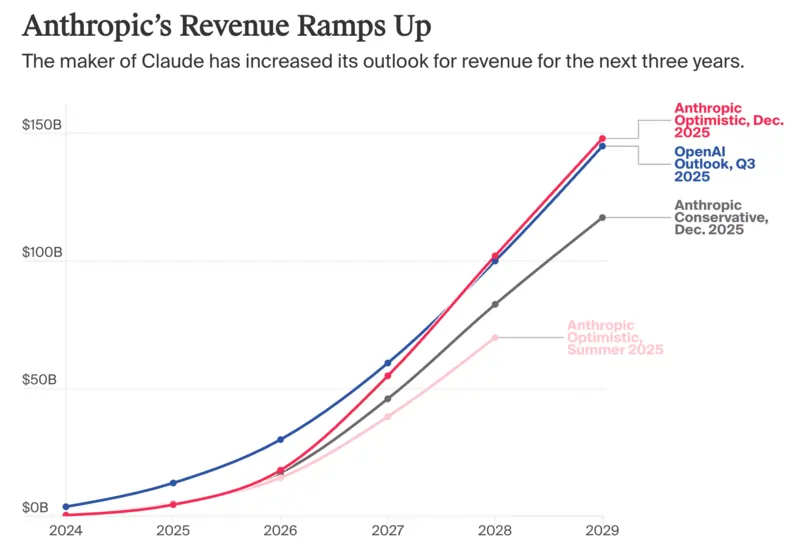

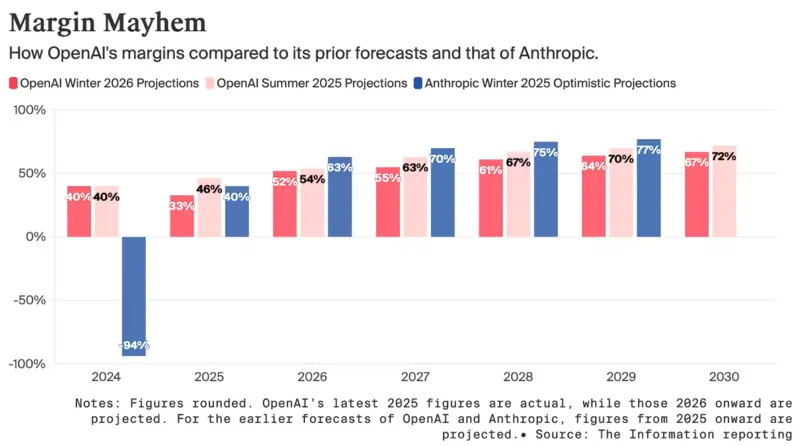

Alla fine, osservando le mosse di Anthropic, emerge una considerazione piuttosto chiara: Claude e il team che c’è dietro sembrano avere una lettura molto lucida di come si muoverà il mercato dell’IA nei prossimi anni.

La sensazione è che abbiano già interiorizzato un fatto semplice: nello scontro tra giganti, Google resta una forza enorme, con infrastrutture, dati e distribuzione difficili da eguagliare. Una macchina di dimensioni tali da rendere improbabile una vera competizione.

In questo scenario entra anche OpenAI, che sta combattendo la sua battaglia per dominare l’AI consumer. ChatGPT punta a essere l’assistente universale, installato nei telefoni, nelle auto, nei frigoriferi.

Anthropic, invece, sembra aver scelto un’altra strada.

Più che cercare di competere direttamente nello stesso spazio, sta costruendo una identità distinta. Non il modello per tutti, ma il modello pensato per contesti specifici: sviluppo software, utilizzo aziendale, integrazione nei processi professionali di realtà complesse.

A questo si aggiunge un altro elemento interessante: il posizionamento etico e politico.

La decisione di non piegarsi alle richieste del governo statunitense sulla condivisione dei dati è stata raccontata come una scelta di principio. È possibile che lo sia davvero, considerata la biografia dei fondatori, usciti da OpenAI proprio per ragioni di sicurezza. Allo stesso tempo, possiede una forte dimensione strategica che fa scuola.

Nel mercato enterprise la fiducia è tutto.

Un’azienda che adotta un modello IA, esattamente come potresti fare tu con la tua impresa, vuole sapere con assoluta certezza che i propri dati, i propri segreti commerciali e le informazioni dei propri clienti non verranno riutilizzati o monetizzati altrove.

Vuole blindare i propri flussi di lavoro. Mostrarsi inflessibili sui temi della sicurezza nazionale e della sorveglianza contribuisce a costruire esattamente quel tipo di reputazione d’acciaio.

In altre parole, Anthropic sta facendo qualcosa che molte aziende dichiarano nelle presentazioni PowerPoint, ma poche realizzano davvero. Sta lavorando sulla propria identità di brand in modo profondo mentre il mercato si sta ancora formando, come ha scritto anche Mordy Oberstein su LinkedIn.

Se Google domina l’infrastruttura di base e OpenAI conquista l’attenzione frenetica del pubblico comune, Anthropic sembra voler diventare il punto di riferimento assoluto per chi usa l’intelligenza artificiale dentro le organizzazioni lavorative.

Tutto questo avviene per motivi precisi. Non necessariamente perché Dario Amodei e soci siano “più buoni” o più virtuosi degli altri giocatori al tavolo.

Più semplicemente perché l’azienda ha capito che, per sopravvivere schiacciata tra giganti da trilioni di dollari, serve strategia: trovare uno spazio ristretto dove competere davvero, dominandolo, e costruire intorno a quel perimetro un’identità aziendale chiara, fiera e riconoscibile.

E, a giudicare dalle scelte sofferte e dai boicottaggi di queste ultime settimane, sembra che stiano lavorando esattamente in quella direzione.

Ora spetta a te prendere appunti. Scegliere a chi affidare i dati del tuo sito e le sorti della tua azienda online non è mai stata un’operazione tecnica.

È diventata la scelta politica e strategica più vitale del decennio.

Scontro Anthropic VS Pentagono: domande frequenti

Perché si è creato uno scontro tra il Pentagono e Anthropic? Il Pentagono ha chiesto ad Anthropic di rimuovere i limiti di sicurezza dal modello Claude per consentirne qualsiasi uso legittimo in ambito militare. L’azienda ha rifiutato perché ha stabilito due linee rosse: non permettere la sorveglianza di massa sui cittadini americani e non consentire l’uso dell’intelligenza artificiale per armi completamente autonome senza controllo umano.

Che ruolo ha avuto OpenAI nello scontro tra governo americano e Anthropic?

Dopo il bando di Anthropic da parte del governo statunitense, OpenAI ha firmato un accordo con il Pentagono per permettere l’uso dei suoi sistemi nelle reti militari classificate. Sam Altman ha dichiarato di accettare l’uso per scopi leciti, introducendo però alcune garanzie tecniche per evitare utilizzi impropri.

Perché questa vicenda riguarda anche le aziende che usano l’intelligenza artificiale?

Il caso mostra quanto le imprese possano diventare dipendenti da pochi grandi fornitori di intelligenza artificiale. Blackout tecnici, decisioni politiche o conflitti tra governi e aziende tecnologiche possono bloccare servizi, API e strumenti su cui molte imprese basano contenuti, automazioni e customer care.

Etica usata come brand. Scelta nobile o solo marketing? La coerenza si valuta dopo.

Francesco, un’azienda che rifiuta il diavolo per vendere meglio agli angeli sta solo scegliendo il suo mercato, non la sua anima.